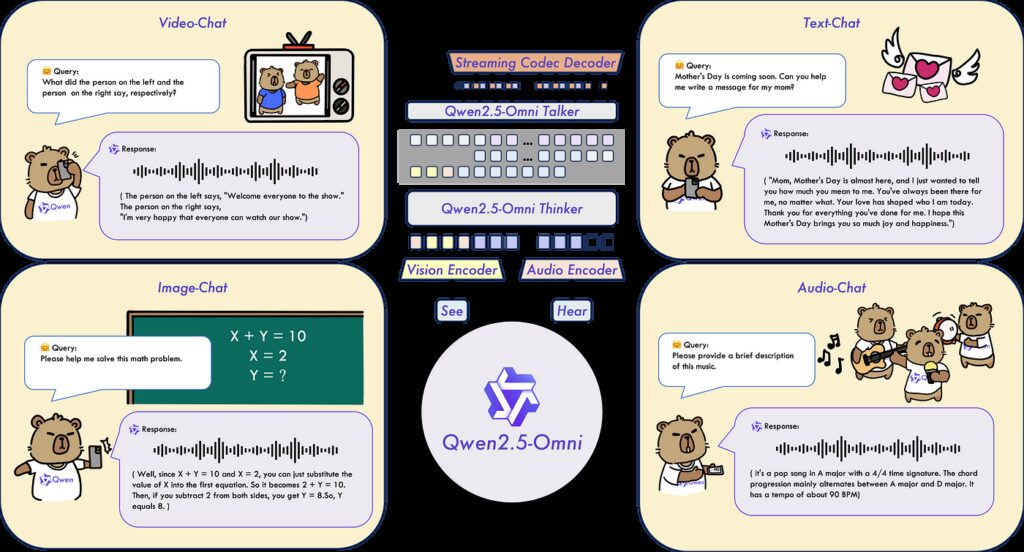

Alibaba Cloud a récemment lancé le modèle Qwen2.5-Omni-7B, une solution multimodale unifiée conçue pour une perception multimodale complète. Ce modèle est capable de traiter différents types de données, y compris des textes, des images, de l'audio et des vidéos, tout en générant des réponses textuelles et des discours naturel en temps réel. Cette innovation établit un nouveau standard pour l'intelligence artificielle multimodale déployable de manière optimale sur des appareils edge, tels que les smartphones et les ordinateurs portables.

Malgré son architecture compacte de 7 milliards de paramètres, Qwen2.5-Omni-7B offre des performances exceptionnelles et des capacités multimodales puissantes. Cette combinaison unique en fait une base idéale pour le développement d'agents d'IA agiles et rentables, offrant une réelle valeur ajoutée, notamment pour les applications vocales intelligentes. Par exemple, ce modèle pourrait transformer les vies en aidant les personnes malvoyantes à naviguer dans leur environnement grâce à des descriptions audio en temps réel, en proposant des instructions de cuisine étape par étape en analysant les ingrédients d'une vidéo, ou en alimentant des dialogues de service client intelligents qui comprennent véritablement les besoins des clients.

Le modèle est dès à présent disponible en open-source sur les plateformes Hugging Face et GitHub, ainsi qu'à travers Qwen Chat et la communauté open-source ModelScope d'Alibaba Cloud. Au cours des dernières années, Alibaba Cloud a mis en open-source plus de 200 modèles d'IA générative.

Performances Remarquables Grâce à une Architecture Innovante

Qwen2.5-Omni-7B se démarque par ses performances exceptionnelles dans toutes les modalités, rivalisant avec des modèles spécifiquement dédiés à une seule modalité de taille comparable. Il établit notamment un nouveau standard pour les interactions vocales en temps réel, générant une synthèse vocale naturelle et robuste, tout en respectant les instructions de discours de bout en bout.

Cette efficacité et cette haute performance sont le résultat d'une architecture innovante incluant l'architecture Thinker-Talker, qui sépare la génération de texte (via Thinker) et la synthèse vocale (via Talker) afin de minimiser les interférences entre différentes modalités, garantissant ainsi une qualité de sortie supérieure. Le TMRoPE (Time-aligned Multimodal RoPE) est une technique d'embedding de position conçue pour mieux synchroniser les entrées vidéo avec l'audio, entraînant une génération de contenu cohérente. De plus, un traitement en streaming par blocs permet de garantir des réponses audio à faible latence, rendant les interactions vocales encore plus fluides.

Performances Exceptionnelles Malgré sa Taille Compacte

Qwen2.5-Omni-7B a été pré-entraîné sur un vaste jeu de données varié, comprenant des données image-texte, vidéo-texte, vidéo-audio, audio-texte et texte, ce qui garantit sa robustesse sur diverses tâches.

Grâce à son architecture novatrice et à son jeu de données de haute qualité, le modèle excelle dans l'exécution des commandes vocales, atteignant des niveaux de performance comparables à ceux des entrées textuelles pures. Pour les tâches nécessitant l'intégration de plusieurs modalités, comme celles évaluées par l'OmniBench – un critère d'évaluation qui mesure la capacité des modèles à reconnaître, interpréter et raisonner sur des entrées visuelles, acoustiques et textuelles – Qwen2.5-Omni atteint des performances de pointe.

Ce modèle démontre également de hautes performances en matière de compréhension et de génération de discours robuste grâce à l'apprentissage contextuel en cours (ICL). De plus, après optimisation via l'apprentissage par renforcement (RL), Qwen2.5-Omni-7B a montré des améliorations significatives en termes de stabilité de génération, avec des réductions notables dans les erreurs d'attention, de prononciation et des pauses inappropriées lors des réponses orales.

Historique et Contexte

Alibaba Cloud a dévoilé le modèle Qwen2.5 en septembre dernier, suivi du lancement de Qwen2.5-Max en janvier, qui s’est classé 7e sur Chatbot Arena, rivalisant avec d’autres LLM propriétaires de premier plan et démontrant des capacités exceptionnelles. En outre, Alibaba Cloud a également mis à disposition en open-source Qwen2.5-VL et Qwen2.5-1M, qui améliorent la compréhension visuelle et le traitement de longs contextes d'entrée.

En résumé, Qwen2.5-Omni-7B se positionne comme une avancée majeure dans le domaine de l'intelligence artificielle multimodale, proposant une architecture avancée et des performances remarquables sur des appareils compacts. Ce modèle marque une étape importante dans l’évolution des applications d’IA, apportant des solutions innovantes et pratiques dans divers aspects de la vie quotidienne.